KI-Service Plattform

Mandantenfähige Backend-Plattform mit spezialisierten KI-Engines für Lernsysteme und weitere Applikationen

- KI

- Webapplikation

- Laravel

Kunde

Vertraulicher Auftraggeber

Mehrwert

- Positives Feedback im KI-Tutor: 98,4 %

- Indexierte Lerndokumente: 47.000+

- Verarbeitete Interaktionen: 155.000+

Tätigkeiten

Konzeption, Architektur, Backend-Entwicklung, KI-Engines, Super-Admin- und Mandanten-Panel, Queuing-System.

Besonderheiten

Mandantenfähig. Spezialisierte KI-Engines, z.B. Tutor, Exercise-Chat, Übersetzung, alternative Erklärung, stellen ihre Funktionen anderen Applikationen über Schnittstellen bereit. Ausgeklügeltes Queuing-System für hohe Lastspitzen.

KI-Features einbauen, ohne ein KI-Team aufbauen zu müssen

Wer eine umfangreiche, hochfrequentierte Applikation anbietet, kennt die Lage: KI-Funktionen sollen das Produkt erweitern, aber wenige möchten dafür ein eigenes KI-Team aufbauen, Modelle vergleichen, Prompts pflegen und Lastsituationen abfangen. Genau dafür wurde die KI-Service Plattform gebaut.

Sie stellt KI-Funktionen als fertige, klar abgegrenzte Engines über Schnittstellen bereit. Anbindende Anwendungen integrieren das gewünschte Feature und behalten ihre Entwickler:innen frei für ihre Kernthemen. Die KI-Logik liegt einmal zentral, statt in jedem Projekt neu gebaut zu werden. Das verkürzt die Zeit bis zum nächsten KI-Feature spürbar.

Die Plattform ist mandantenfähig: Über ein Super-Admin-Panel werden Mandanten zentral verwaltet, jeder Mandant erhält zusätzlich ein eigenes Admin-Panel für seine Inhalte, Reports und Einstellungen. So trägt eine Plattform mehrere Anbieter parallel.

- 98,4 % Positives Feedback im KI-Tutor

- 47.000+ Indexierte Lerndokumente

- 155.000+ Verarbeitete Interaktionen

-

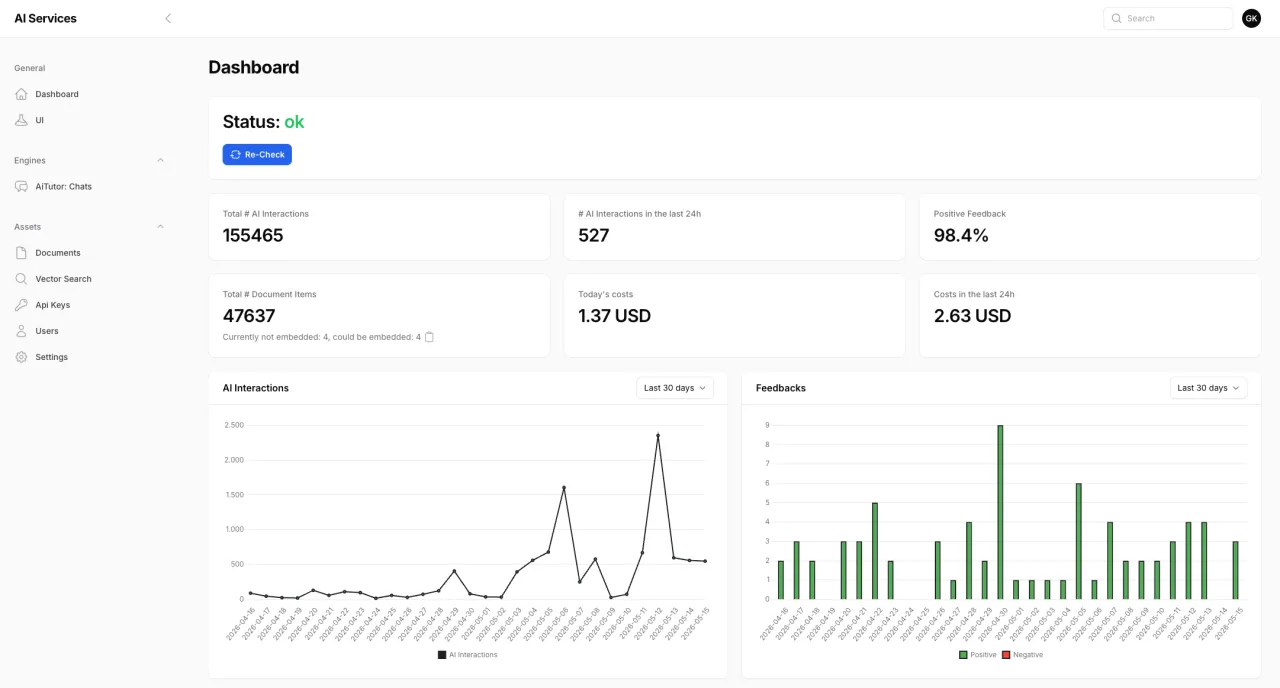

Reporting Dashboard eines Mandanten

Spezialisierte Engines für unterschiedliche Aufgaben

Nachfolgend findet sich eine Auswahl der umgesetzten Engines. Jede ist auf eine konkrete Aufgabe zugeschnitten: einbindbare Bausteine, aus denen anbindende Applikationen ihre KI-Funktionen zusammenstellen.

- KI-Tutor

-

Beantwortet Fragen zu definierten Themen über eine semantische Suche in den hinterlegten Lerndokumenten. Aktuell die meistgenutzte Engine der Plattform.

- Übungs-Chat

-

Geführte Dialoge für Sprach- oder Themen-Trainings, z. B. Rollenspiele in einer Einkaufssituation oder simulierte Prüfungsgespräche.

Erkennt im Chatverlauf, ob das Lernziel erreicht wurde, und liefert Hinweise zur Verbesserung.

- Übungshinweise

-

Erzeugt automatisiert Hinweise zu Übungen, die in der Autorenarbeit häufig aus Zeitgründen ausgespart bleiben.

- Text-Transformation & Übersetzung

-

Wandelt Texte um, z. B. in eine einfacher verständliche Sprache, oder übersetzt sie in andere Sprachen.

- Alternative Erklärung

-

Liefert eine alternative Erklärung, falls die ursprüngliche nicht verstanden wird oder zur Lernsituation nicht passt.

- Konvertierungs-Engine

-

Wandelt Chatverläufe mit menschlichen Tutoren in verarbeitbare, speicherbare Wissensdokumente um und entfernt dabei nicht benötigte Daten, z. B. Personenbezüge oder den Gesprächs-Overhead. Damit können bereits beantwortete Fragen automatisch in Zukunft von der KI beantwortet werden. Dies verbessert den Wissenspool und spart den Tutoren Zeit, da sie Fragen nur einmal beantworten müssen.

- Freitext Antwort-Bewertung

-

Bewertet eine Freitextantwort daraufhin, ob sie ein definiertes Lernziel erfüllt.

- Lösungs-Erklärung

-

Erklärt eine vorgegebene Lösung Schritt für Schritt, damit die Logik nachvollziehbar wird.

Vektorsuche und Retrieval-Augmented Generation (RAG)

Damit der KI-Tutor und verwandte Engines die richtigen Antworten liefern, müssen sie die richtigen Quellen finden, aktuell aus über 47.000 Lerndokumenten. Eine reine Stichwortsuche reicht dafür nicht: Sie würde nur dann passende Inhalte liefern, wenn Lernende exakt jene Begriffe verwenden, die auch im Dokument stehen.

Stattdessen nutzt die Plattform unter anderem eine Vektorsuche. Jedes Dokument wird so abgelegt, dass nicht nur Wörter, sondern auch deren Bedeutung berücksichtigt wird. Eine Frage findet auch dann den passenden Lerninhalt, wenn er ganz andere Begriffe verwendet, und sinngleiche, verwandte oder kontextnahe Dokumente werden mitgeliefert.

Auf dieser Suche setzt Retrieval-Augmented Generation (RAG) auf: Die gefundenen Dokumente werden zusammen mit der Frage an das Sprachmodell übergeben. So basiert jede Antwort auf den tatsächlich vorhandenen Lerninhalten – nicht auf dem allgemeinen Weltwissen des Modells, das schnell ungenau oder unzutreffend werden könnte. Zusätzlich wird gleich die jeweilige Quelle mit angegeben.

Belastbar unter Spitzenlast

Wenn viele Anwender:innen gleichzeitig mit der angebundenen Lernplattform arbeiten, treffen kurzfristig sehr hohe Anfragevolumen auf die Plattform – und genau dann darf sie nicht ausfallen.

Dafür sorgt ein ausgeklügeltes Queuing-System, das Anfragen geordnet abarbeitet und auch unter Druck stabil bleibt. Anbieter verlassen sich darauf, dass ihre KI-Funktionen verfügbar bleiben, ohne selbst Sorge für die Skalierung tragen zu müssen.

Bereit für weitere Anbieter

Die Plattform ist so gebaut, dass sich einfach weitere Mandanten anbinden lassen. Wer eine bestehende Anwendung um KI-Funktionen erweitern möchte, spart damit den Umweg über eine eigene KI-Entwicklung und kommt deutlich schneller in Produktion.

Wir freuen uns über Ihre Nachricht.